进入docker容器的几种方法:

1、使用docker attach命令进入

docker attach 44fc0f0582d9

但是这种方式有缺点,当多个窗口同时使用该命令进入该容器时,所有的窗口都会同步显示。如果有一个窗口阻塞了,那么其他窗口也无法再进行操作。

2、使用docker exec命令进入

docker exec -it 44fc0f0582d9 /bin/bash

注:如果出现下面的错误:

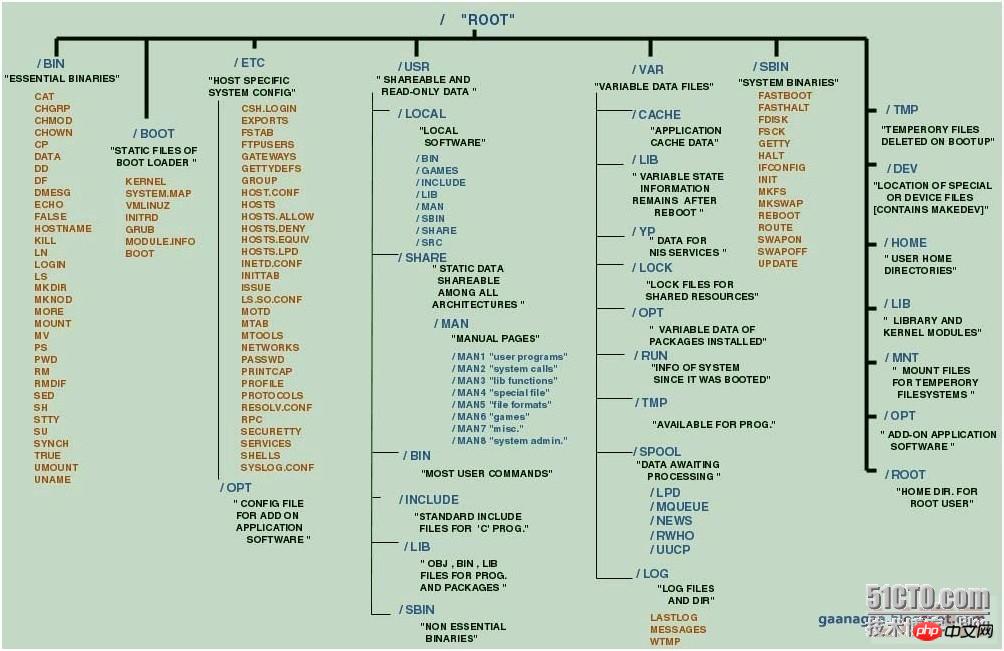

OCI runtime exec failed: exec failed: container_linux.go:345: starting container process caused "exec: "/bin/bash": stat /bin/bash: no such file or directory": unknown

是我们docker镜像中的/bin/bash文件并不存在,可能存在的是/bin/sh文件,使用下面的命令即可:

docker exec -it 44fc0f0582d9 /bin/sh

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END

喜欢就支持一下吧

相关推荐