由于选择的是centos7-dvd镜像自带了open jdk,需要卸载。首先查询自带的jdk:

rpm -qa | grep java

会出现7个带有java名称的东西,删除其中的带有openjdk字样的文件,命令如下:

rpm -e --nodeps java-1.8.0-openjdk-1.8.0.102-4.b14.el7.x86_64 rpm -e --nodeps java-1.8.0-openjdk-headless-1.8.0.102-4.b14.el7.x86_64 rpm -e --nodeps java-1.7.0-openjdk-headless-1.7.0.111-2.6.7.8.el7.x86_64 rpm -e --nodeps java-1.7.0-openjdk-1.7.0.111-2.6.7.8.el7.x86_64

再次执行rpm -qa | grep java命令,就剩下三个:

javapackages-tools-3.4.1-11.el7.noarch tzdata-java-2016g-2.el7.noarch python-javapackages-3.4.1-11.el7.noarch

接着安装自己需要的jdk,首先进入local目录:

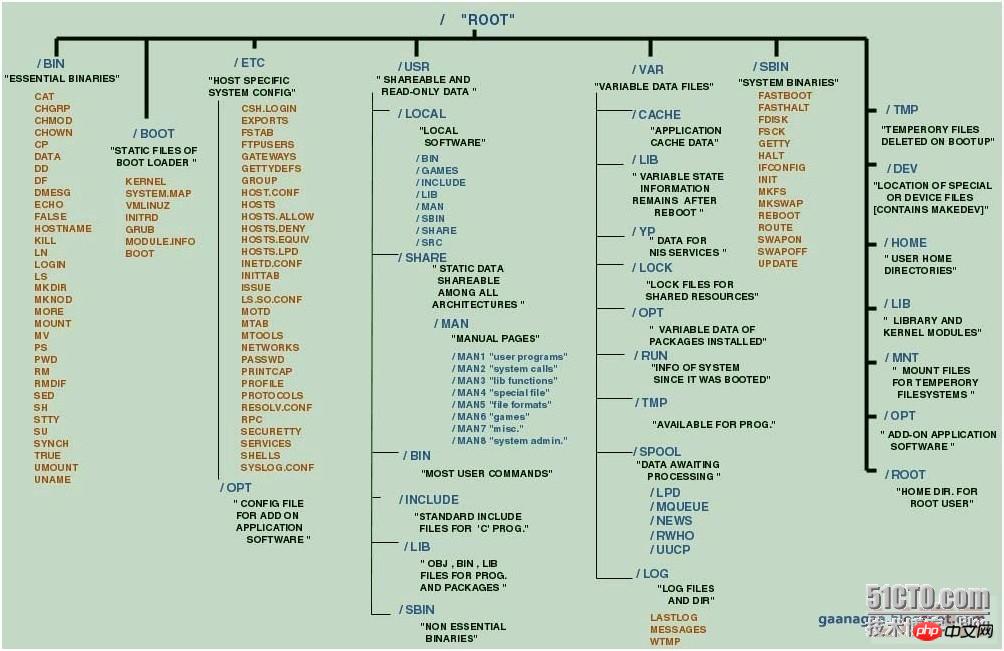

cd /usr/local/

在该目录下建一个文件夹并命名为jdk,用于存放jdk文件。下载文件:

// wget 地址 wget

通过右键->复制链接地址获得url,然后执行命令,爽歪歪,感觉下载速度好快啊!

然后执行命令:

tar -zxvf jdk-8u131-linux-x64.tar.gz

结果出错了,错误信息:

gzip: stdin: not in gzip format tar: Child returned status 1 tar: Error is not recoverable: exiting now

在网上找了好久终于找到了解决方法。首先用file命令查看文件真正属性:

file jdk-8u131-linux-x64.tar.gz

显示结果:

[root@localhost jdk]# file jdk-8u131-linux-x64.tar.gz jdk-8u131-linux-x64.tar.gz: HTML document, ASCII text, with very long lines, with CRLF line terminators

原来下载下来的是网页(html),我说几百兆的东西怎么秒开呢。然后只能手动下载下来了,然后执行rz命令,选中下载的文件传到linux虚拟机,执行解压:

tar -zxvf jdk-8u131-linux-x64.tar.gz

解压后的文件为:

drwxr-xr-x. 8 10 143 4096 3月 15 16:35 jdk1.8.0_131

删除压缩文件(可选):

rm -f jdk-8u131-linux-x64.tar.gz

配置环境变量:

vim /etc/profile

输入i进入编辑模式,在文件末尾添加环境变量:

export JAVA_HOME=/usr/local/jdk/jdk1.8.0_131 export CLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar export PATH=$PATH:$JAVA_HOME/bin

按esc键,输入wq(保存并退出)。

保存完之后,使刚配置的环境生效:

source /etc/profile

检查jdk是否安装完成:

java -version

显示结果:

[root@localhost jdk]# java -version java version "1.8.0_131" Java(TM) SE Runtime Environment (build 1.8.0_131-b11) Java HotSpot(TM) 64-Bit Server VM (build 25.131-b11, mixed mode)

表示配置成功。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END