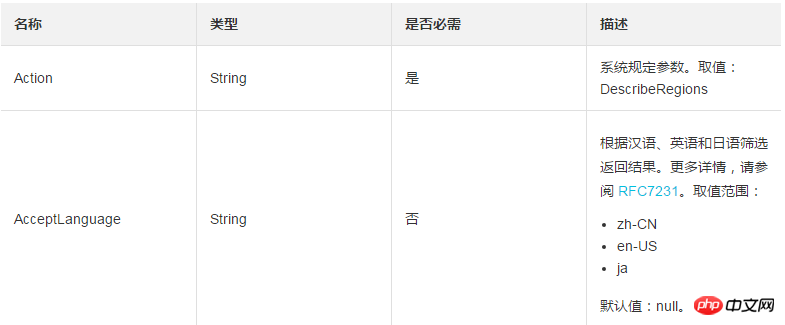

本篇文章给大家带来的内容是关于如何使用describeregions查询可以使用的地域,有一定的参考价值,有需要的朋友可以参考一下,希望对你有所帮助。

DescribeRegions

请求参数

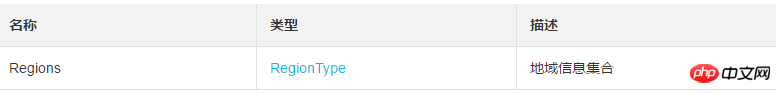

返回参数

示例

请求示例

https://ecs.aliyuncs.com/?Action=DescribeRegions &

返回示例

XML 格式

<describeregionsresponse> <requestid>611CB80C-B6A9-43DB-9E38-0B0AC3D9B58F</requestid> <regions> <region> <regionid>cn-hangzhou </regionid> </region> <region> <regionid>cn-qingdao</regionid> </region> </regions></describeregionsresponse>

JSON 格式

{ "RequestId": "611CB80C-B6A9-43DB-9E38-0B0AC3D9B58F", "Regions": { "Region": [{ "RegionId": "cn-hangzhou " }, { "RegionId": "cn-qingdao" }] } }

错误码

全是公共错误码。更多错误码,请访问 API 错误中心。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END