增强debian hadoop集群的数据安全性,需要多方面协同努力,涵盖系统维护、用户权限管理、数据加密、访问控制、日志审计和安全策略制定等关键环节。以下是一些具体的实施步骤:

一、系统安全维护

- 及时更新: 定期执行apt update和apt upgrade命令,确保系统补丁及时更新,抵御已知漏洞。

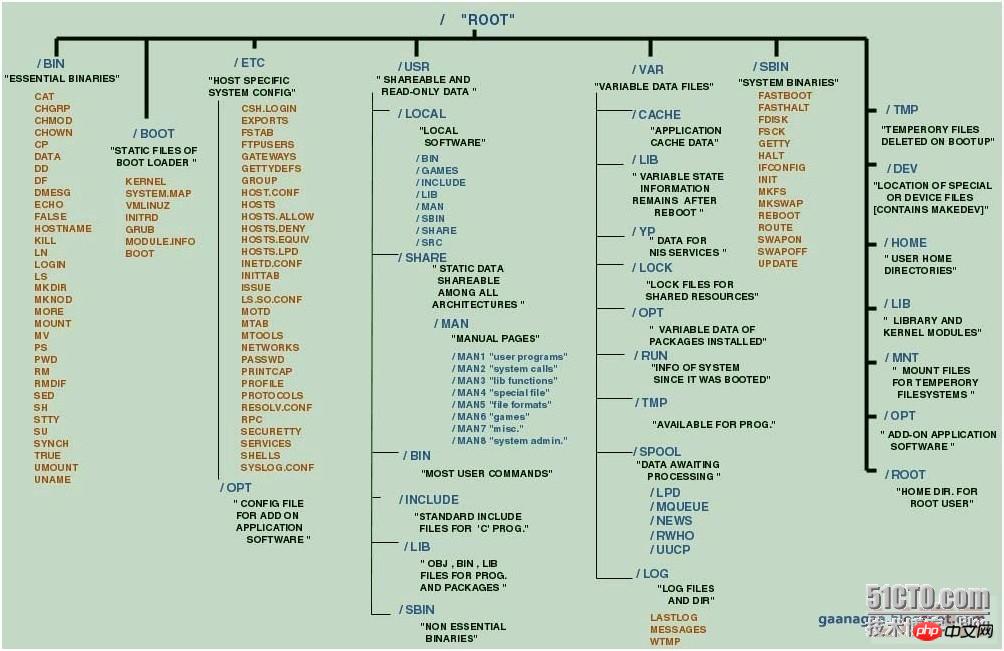

二、用户与权限管理

- 最小权限原则: 创建普通用户并赋予sudo权限,避免直接使用root用户操作。

- ssh密钥认证: 配置SSH密钥对身份验证,禁用root远程登录和空密码登录。

三、数据加密

- 数据加密: 对存储和传输的数据进行加密,例如采用Kerberos认证和ssl/TLS加密,保障数据在静态和动态状态下的安全。

四、访问控制

- 精细化权限控制: 利用诸如apache Ranger之类的工具,实现细粒度的访问控制,确保用户只能访问授权的数据和资源。

- 访问控制列表(ACL): 配置ACL,严格控制用户对Hadoop资源的访问权限。

五、审计日志

- 启用审计日志: 开启Hadoop审计日志功能,记录所有用户对数据的访问和操作,方便追踪异常活动,及时发现和预防未授权访问。

六、安全策略配置

- 防火墙策略: 制定并实施严格的防火墙规则,例如使用iptables,只开放必要的端口(如http、https和SSH),遵循“最小权限原则”,拒绝所有未授权的连接请求。

- 集群安全隔离: 建议集群内服务器关闭防火墙,而对于集群外部访问,只开放必要的端口。

七、其他安全措施

- 数据备份: 制定数据备份策略,定期备份重要数据,以应对数据丢失风险。

通过以上措施,可以有效提升Debian Hadoop集群的安全性,降低数据泄露和系统攻击的风险。 需要注意的是,具体的实施步骤会因Hadoop版本和环境而异,建议参考官方文档和最佳实践指南。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END