升级HDFS涉及系统更新、依赖安装、配置调整和服务重启等步骤。本文提供详细的升级步骤和注意事项,帮助您安全高效地完成HDFS升级。

升级步骤详解

-

确认centos版本:

使用以下命令查看当前CentOS版本:

cat /etc/centos-release

-

数据备份至关重要: 在任何升级操作之前,务必备份所有HDFS数据。

-

系统更新: 使用以下命令更新系统软件包:

sudo yum update -y

-

安装必要组件: 安装必要的软件包,例如GCC和OpenSSH客户端:

sudo yum install -y gcc openssh-clients

-

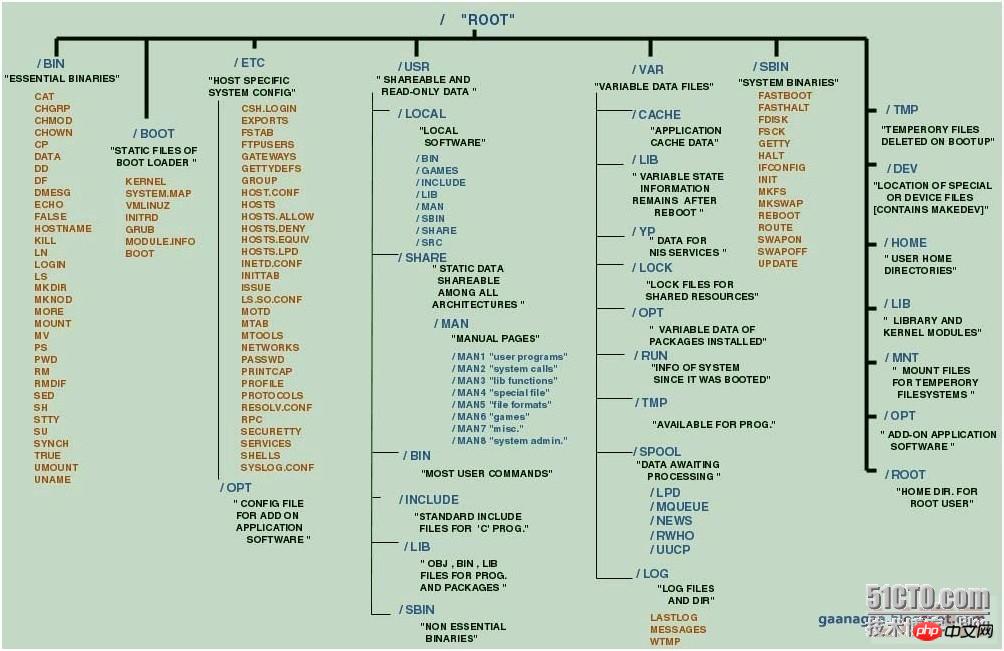

配置HDFS环境:

-

停止HDFS服务: 升级前,务必停止HDFS NameNode和DataNode服务:

sudo systemctl stop hadoop-namenode sudo systemctl stop hadoop-datanode

-

滚动升级HDFS: 推荐使用滚动升级模式,以避免服务中断。执行以下命令:

sudo hdfs namenode -upgrade sudo hdfs datanode -upgrade

-

升级验证: 升级完成后,使用以下命令检查HDFS服务状态和集群报告:

sudo hdfs dfsadmin -report

升级注意事项

- 数据备份: 再次强调,升级前务必备份所有重要数据,以防数据丢失。

- 兼容性问题: 升级过程中可能出现兼容性问题,请参考Hadoop官方文档和社区资源解决。

- 测试环境验证: 在生产环境升级前,建议先在测试环境中进行完整测试。

以上步骤仅供参考,实际升级过程可能因环境差异而有所不同。 请务必参考Hadoop官方文档,或寻求专业人士的帮助。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END