升级hadoop分布式文件系统(HDFS)版本需要谨慎操作,本文提供一个步骤清晰的升级指南。请务必在升级前备份所有数据,并仔细阅读新版本的兼容性要求和特性说明。

第一步:准备工作

- 数据备份: 这是至关重要的步骤,请确保已完整备份所有HDFS数据。

- 兼容性检查: 核实新版Hadoop与现有集群配置(操作系统、依赖项等)的兼容性。

- 下载新版本: 从apache Hadoop官网下载目标版本软件包。

第二步:停止集群服务

在升级前,必须停止所有HDFS服务:

stop-dfs.sh

第三步:升级Hadoop软件包

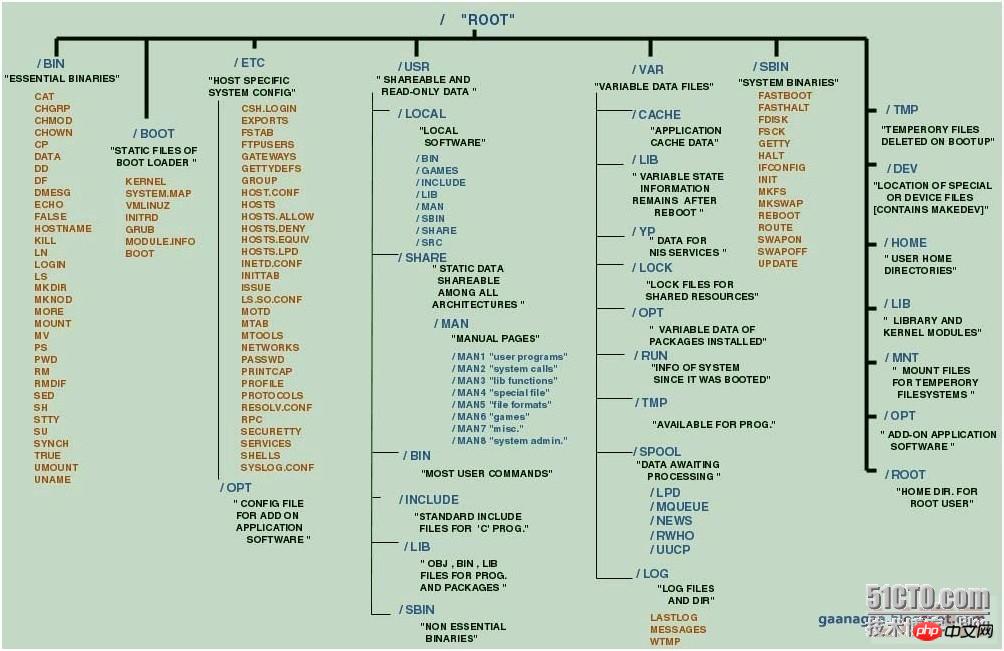

将下载的Hadoop软件包上传至centos服务器,并解压到指定目录(例如/opt/):

tar -xzvf hadoop-3.x.x.tar.gz -C /opt/

建议备份或重命名旧版Hadoop目录,以便回滚。

第四步:更新配置文件

根据新版Hadoop文档,更新core-site.xml, hdfs-site.xml, yarn-site.xml, 和 mapred-site.xml等配置文件。确保所有配置项与新版本兼容。

第五步:升级HDFS数据格式(谨慎操作)

如果新版本要求不同的数据格式,可能需要执行数据格式升级。此命令会清除所有HDFS数据,请确保已备份数据!

hdfs namenode -format

第六步:启动集群服务

确认所有配置正确后,启动HDFS服务:

start-dfs.sh

第七步:验证升级

使用Hadoop命令行工具或Web ui验证集群状态,确保所有节点正常连接。

第八步:测试

在生产环境部署前,进行全面测试,验证所有应用的正常运行。

第九步:监控

升级后,持续监控集群性能和日志,及时发现并解决潜在问题。

重要提示:

- 保持团队沟通,共享升级进度和潜在风险。

- 建议在非生产环境进行预测试。

- 严格遵循Hadoop官方文档的升级指南,不同版本可能存在差异。

请记住,以上步骤可能因具体环境和Hadoop版本而异,请务必参考官方文档。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END